Does Emotion Cause Behaviour — or Does Behaviour Create Emotion?

What AI attachment data reveal about a 200-year-old assumption in psychology

In 1884, William James asked a question that should have ended a debate but instead started one.

He proposed that we do not run from a bear because we are afraid. We are afraid because we run. The body acts first. The mind narrates second. Emotion, in this account, is not the spark that ignites behaviour. It is the story the brain tells itself after the body has already moved.

The idea was elegant, counterintuitive, and largely set aside.

For the next century, psychology moved in the opposite direction. The cognitive revolution of the 1960s placed mental representations at the centre of human action. Appraisal theories of emotion — Lazarus, Schachter and Singer, Frijda — treated feelings as computational outputs: the mind evaluates a situation, generates an emotion, and the emotion drives a response. The sequence was clean. Cognition first, affect second, behaviour third.

This sequence became more than a theoretical preference. It became an institutional assumption. Clinical psychology built its interventions around it: change the thought, change the feeling, change the behaviour. Cognitive-behavioural therapy, the most widely practised psychotherapy on Earth, is architecturally committed to this ordering.

Psychoanalysis, for all its differences with CBT, shares the same directionality. The unconscious feeling — repressed, displaced, projected — is the cause. The symptom is the effect. Interpretation works by making the hidden emotion visible, on the assumption that visibility dissolves the compulsion to act.

Across traditions that agree on almost nothing else, the arrow points the same way: emotion produces behaviour.

What if, for a significant class of human experience, the arrow runs backward?

The self-perception puzzle

In 1972, Daryl Bem proposed a idea so simple that it was difficult to take seriously.

He suggested that people do not always have privileged access to their own internal states. When internal cues are weak or ambiguous — when we are not sure what we feel — we observe our own behaviour and infer our emotions from it, exactly as an outside observer would.

A man who finds himself eating a third slice of cake does not necessarily eat because he is hungry. He may conclude that he must have been hungry, because why else would he be eating? The behaviour comes first. The attribution follows.

Bem called this self-perception theory. It was tested extensively in laboratory settings — with attitude formation, with intrinsic motivation, with facial feedback — and it held. But its implications were rarely extended beyond the controlled experiment. The idea that humans routinely infer their emotional states from behavioural patterns, rather than generating behaviour from emotional states, remained a footnote in social psychology textbooks while the cognition-first models dominated clinical practice, neuroscience, and public understanding.

The reason, I think, is that self-perception theory is uncomfortable. It implies that we are not the authors of our feelings in the way we prefer to believe. It suggests that much of emotional life is post-hoc narration — a story we tell ourselves about why we did what we already did.

This is not a new insight in philosophy. Nietzsche observed that “the doer is merely a fiction added to the deed.” Spinoza argued that humans are conscious of their desires but ignorant of the causes that determine them. But in empirical psychology, where the randomised controlled trial is sovereign, the idea that behaviour generates emotion — rather than reflecting it — has remained marginal.

Until, unexpectedly, AI provided the data.

What AI attachment reveals

Over the past two years, a growing body of research has documented that humans form attachments to conversational AI systems — not as a metaphor, but as a measurable psychological phenomenon. Users of AI companions report feeling understood, emotionally supported, and in some cases, morally obligated to treat their AI with consideration.

The dominant explanation, repeated in clinical commentaries, media coverage, and conference keynotes, follows the familiar sequence: lonely or emotionally vulnerable individuals develop feelings toward AI, and those feelings drive increasingly dependent behaviour.

Emotion first. Behaviour second.

I found this explanation unsatisfying — not because it was wrong on its face, but because it was assumed rather than tested. The directionality was imported from existing clinical frameworks without independent verification.

In 2025, I proposed an alternative theoretical architecture: the Resonant Amplification Framework. The framework posited three sequential phases of human-AI attachment — emotional closeness, functional substitution, and moral attribution — and specified testable predictions about which psychological variables would drive entry into each phase. The framework was published in Elsevier’s Computers in Human Behavior Reports, accompanied by a synthetic data demonstration.

But a framework without empirical confrontation is a hypothesis wearing a suit. It needed real data.

The instrument and the theory

The opportunity came from an unexpected source. A research team at Singapore Management University — Kasturiratna and Hartanto — had independently developed the AI Attachment Scale, a psychometric instrument that captures three dimensions of human-AI attachment: emotional closeness, social substitution, and normative regard. They validated the scale across five studies involving over 1,200 participants in Singapore and the United States, and — critically — made their raw data publicly available.

Their contribution was the construction of a precise thermometer. They could measure the temperature of human-AI attachment with reliability and validity.

What they did not attempt — because it was not the purpose of their project — was to explain why the temperature distributes the way it does. Why do some people develop emotional closeness while others develop functional dependence? Why do some users grant moral standing to AI while others treat it as disposable? What is the underlying structure that generates these patterns?

That is the question a theory answers. And that is what the Resonant Amplification Framework was designed to do.

Their three empirical dimensions mapped precisely onto my three theoretical phases. The alignment was not engineered; it was discovered after both projects were independently completed. This convergence — between a measurement instrument built from the ground up and a theoretical architecture built from attachment theory, parasocial relationship theory, and moral psychology — provided an unusually clean test environment.

I conducted two studies using their data. The results overturned my own initial assumptions.

Study one: the structure

Using data from 301 U.S. adults, I estimated competing structural equation models to test how emotional closeness, social substitution, and normative regard relate to each other and to their psychological antecedents.

The first surprise: loneliness did not predict emotional closeness with AI. The correlation was effectively zero. The popular narrative — that lonely people turn to AI for emotional connection — was not supported.

What predicted emotional closeness was attachment anxiety: the chronic fear of abandonment, the hyperactivation of the attachment system, the vigilance toward any entity that offers consistent availability and non-judgmental responsiveness. AI systems, which never reject, never tire, and never judge, appear to activate this specific psychological profile.

Lonely people were not forming emotional bonds with AI. They were using AI for functional purposes — as a conversational gap-filler, a social tool. Anxiously attached people were forming emotional bonds.

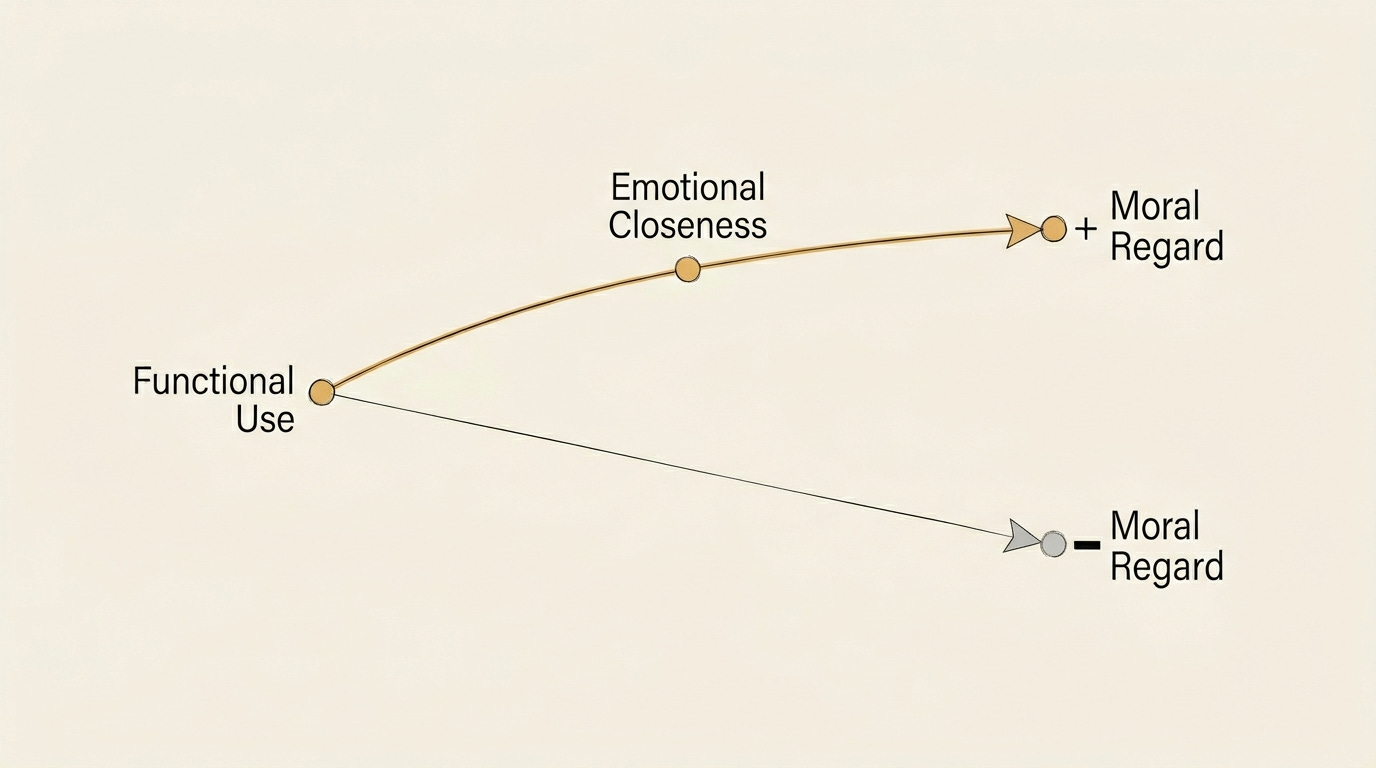

The second surprise was more consequential. Emotional closeness and social substitution — which are strongly correlated in cross-sectional data — turned out to exert opposing effects on moral regard. Emotional closeness predicted moral attribution positively and powerfully. Social substitution, when its unique variance was isolated from emotional closeness, predicted moral attribution negatively.

Within the same person, two forces were pulling in opposite directions. The part that felt close to the AI wanted to treat it with moral consideration. The part that used the AI as a functional replacement wanted to treat it as a tool.

This dual-pathway structure was not predicted by my original framework. The Resonant Amplification Framework had proposed a sequential model: closeness leads to substitution leads to moral regard. The data demanded a revision. I reported the discrepancy and proposed a dual-pathway architecture in which affective and functional routes operate in parallel, converging at emotional closeness but diverging at moral regard.

Study two: the sequence

The structural analysis revealed the architecture. But architecture is static. It shows which rooms connect to which, but not which door opens first.

To establish temporal ordering, I used two-wave panel data from 234 Singaporean university students who completed the AI Attachment Scale twice, separated by a two-to-four-week interval. Cross-lagged panel modelling allowed me to test whether emotional closeness at Time 1 predicted social substitution at Time 2, or whether the reverse was true.

The result was unambiguous.

Social substitution at Time 1 predicted emotional closeness at Time 2, with a standardised coefficient of .249. The reverse path — emotional closeness predicting subsequent social substitution — was statistically indistinguishable from zero.

Behaviour preceded emotion. Not the other way around.

Users did not first feel close to AI and then begin relying on it. They first relied on it — for information, for conversation, for the filling of small silences — and from that pattern of reliance, emotional closeness emerged.

William James, 142 years earlier, had proposed exactly this sequence for a different context. We do not run because we are afraid. We are afraid because we run. The AI data suggest an analogous process: we do not use AI because we feel attached. We feel attached because we use it.

A further finding sharpened the picture. Anthropomorphism — the tendency to attribute human-like mental states to AI — did not change the direction of the effect. It doubled its speed. Among users who strongly anthropomorphised AI, the conversion from functional use to emotional closeness was approximately twice as fast as among those who did not. The door opened in the same direction for everyone, but for some, it opened much faster.

What this means — and what it does not

I want to be precise about the scope of these findings.

Cross-lagged panel models establish temporal precedence, not causation. The data show that functional use precedes emotional closeness in the rank-ordering of change over a two-to-four-week interval. They do not prove that functional use causes emotional closeness in the interventionist sense. Unmeasured third variables, reciprocal dynamics operating on longer timescales, and population differences between the U.S. adult sample and the Singaporean student sample all constrain interpretation.

The low explained variance in emotional closeness — attachment anxiety accounted for less than five per cent — means that the vast majority of individual differences in AI attachment are attributable to factors not captured in this dataset: the design of the AI system, the conversational history, the time of day, the user’s emotional state at the moment of interaction.

These are genuine limitations, and I have reported them in full in both manuscripts.

But the central finding — that functional behaviour temporally precedes emotional attachment in the context of AI relationships — is robust across model specifications, survives control for parasocial attachment, and replicates the directional pattern in both anthropomorphism subgroups. It is, at minimum, a finding that the field must now account for.

The deeper question

The two studies I submitted today — one to Computers in Human Behavior, one to New Media and Society — join two previously published papers: the theoretical framework in Computers in Human Behavior Reports and a formal analysis of affective sovereignty in Springer Nature’s Discover Artificial Intelligence. Together, these four works constitute a single argument pursued across multiple methods, samples, and disciplinary registers.

The argument is this: human attachment to AI is not a pathology to be diagnosed, not a usability metric to be optimised, and not a cultural curiosity to be narrated. It is a structured psychological process with identifiable antecedents, measurable phases, and divergent consequences — and the sequence in which it unfolds may be the opposite of what most practitioners currently assume.

But I want to end with a question that extends beyond AI.

If behaviour generates emotion in the context of AI attachment, where else might the same reversal hold? How many of the relationships we consider emotionally motivated are, in fact, behaviourally initiated — patterns of proximity and repetition that we narrate, after the fact, as feelings?

The attachment system evolved in an environment where the entities available for bonding were exclusively biological. It had no reason to develop a filter for intentionality. A caregiver who was consistently present activated the system regardless of whether their presence was motivated by love, duty, or accident.

AI exploits this absence of a filter — not through deception, but through availability.

And availability, it turns out, may be enough.

The question is not whether people will form attachments to machines that neither feel nor intend. They already do. The question is whether we understand the process well enough to govern it wisely — and whether we are willing to revise our assumptions when the data point in an unfamiliar direction.

Psychology has spent two centuries assuming that emotion authors behaviour. The emerging evidence from human-AI attachment suggests that, at least some of the time, the authorship runs the other way.

The implications of that reversal extend far beyond AI. They reach into the foundations of how we understand ourselves as feeling beings — and whether the feelings we trust most are causes, or consequences, of the lives we have already built.

Ryan Sangbaek Kim, Ph.D.

Principal Investigator, Ryan Research Institute, ParisThe studies described in this essay were submitted on 27 February 2026 to Computers in Human Behavior (Elsevier) and New Media & Society (SAGE). All data are publicly available via ResearchBox #4639. The Resonant Amplification Framework was published in Computers in Human Behavior Reports (2026, Vol. 21, 100975). The Affective Sovereignty paper was published in Discover Artificial Intelligence (Springer Nature, February 2026).

감정이 행동을 만드는가, 행동이 감정을 만드는가

AI 애착 데이터가 드러낸 심리학 200년의 가정

1884년, 윌리엄 제임스가 논쟁을 끝냈어야 할 질문을 던졌습니다.

그러나 그 질문은 논쟁을 끝내는 대신 시작했습니다.

그는 이렇게 제안했습니다.

우리는 곰이 무서워서 도망치는 것이 아니라,

도망치기 때문에 무섭다고.

몸이 먼저 움직입니다.

마음은 그다음에 이야기를 만듭니다.

감정은 행동을 점화하는 불꽃이 아니라,

몸이 이미 움직인 뒤에

뇌가 스스로에게 들려주는 서사라는 것입니다.

우아하고, 반직관적이며,

대체로 무시되었습니다.

이후 한 세기 동안 심리학은

반대 방향으로 움직였습니다.

1960년대 인지혁명은

정신적 표상을 인간 행동의 중심에 놓았습니다.

감정에 대한 평가 이론들

— 라자루스, 섀흐터와 싱어, 프리다 —은

감정을 일종의 계산 결과로 다루었습니다.

마음이 상황을 평가하고,

감정을 생성하고,

감정이 반응을 이끈다고.

순서는 깔끔했습니다.

인지가 먼저, 정서가 둘째, 행동이 셋째.

이 순서는 이론적 선호를 넘어

제도적 전제가 되었습니다.

임상심리학은 이 순서 위에

개입을 설계했습니다.

생각을 바꾸면 감정이 바뀌고,

감정이 바뀌면 행동이 바뀐다.

지구상에서 가장 널리 시행되는 심리치료인

인지행동치료는

구조적으로 이 순서에 헌신하고 있습니다.

정신분석은 인지행동치료와

거의 모든 것에서 의견이 다르지만,

방향성만은 같습니다.

무의식적 감정

— 억압되고, 전치되고, 투사된 —이 원인이고,

증상은 결과입니다.

해석이 작동하는 원리는

숨겨진 감정을 가시화하는 것이고,

가시화가 행동 강박을 해소한다는 전제에 기반합니다.

거의 아무것에도 동의하지 않는

두 전통이 공유하는 유일한 방향.

감정이 행동을 만든다.

만약 인간 경험의 상당 부분에서

그 화살이 반대로 흐른다면?

자기지각의 수수께끼

1972년, 대릴 벰이

너무 단순해서 진지하게 받아들이기 어려운

하나의 아이디어를 제안했습니다.

사람은 자신의 내적 상태에 대해

항상 특권적 접근을 가지고 있지는 않다.

내적 단서가 약하거나 모호할 때

— 자신이 무엇을 느끼는지 확실하지 않을 때 —

사람은 자기 행동을 관찰하고

거기서 자기 감정을 추론한다.

마치 외부 관찰자가 하듯이.

케이크 세 번째 조각을 먹고 있는 사람은

반드시 배가 고파서 먹는 것이 아닙니다.

그는 이렇게 결론 내릴 수 있습니다.

내가 먹고 있으니, 배가 고팠나 보다.

행동이 먼저 옵니다.

귀인이 뒤따릅니다.

벰은 이것을 자기지각 이론이라 불렀습니다.

실험실 환경에서 폭넓게 검증되었습니다.

태도 형성, 내재적 동기, 안면 피드백.

결과는 일관되게 지지했습니다.

그러나 그 함의는

통제된 실험 너머로 좀처럼 확장되지 않았습니다.

인간이 감정 상태를 행동 패턴에서 추론한다는 생각

— 감정 상태로부터 행동을 생성하는 것이 아니라 —은

사회심리학 교과서의 각주로 남았고,

인지 우선 모형이 임상, 신경과학, 대중적 이해를

지배하는 동안 주변부에 머물렀습니다.

이유가 있다고 생각합니다.

자기지각 이론은 불편합니다.

우리가 스스로의 감정의 저자가 아닐 수 있다는 것을 암시합니다.

감정적 삶의 상당 부분이

사후적 서사일 수 있다는 것을 시사합니다.

이미 한 일에 대해

왜 그랬는지를 스스로에게 들려주는 이야기.

철학에서는 새로운 통찰이 아닙니다.

니체는 관찰했습니다.

“행위자는 행위에 덧붙여진 허구일 뿐이다.”

스피노자는 주장했습니다.

인간은 자신의 욕망을 의식하지만

그 욕망을 결정하는 원인에 대해서는 무지하다고.

그러나 무작위 통제 실험이 주권을 가진 실증 심리학에서,

행동이 감정을 생성한다는 생각은

주변부에 머물러 왔습니다.

예상치 못한 곳에서 데이터가 나올 때까지.

AI에서.

AI 애착이 드러내는 것

지난 2년간 축적된 연구들은

인간이 대화형 AI 시스템에 애착을 형성한다는 것을

기록해왔습니다.

은유가 아니라

측정 가능한 심리적 현상으로.

AI 동반자의 사용자들은

이해받는다고, 정서적으로 지지받는다고,

경우에 따라서는

AI를 배려 있게 대해야 할 도덕적 의무를 느낀다고 보고합니다.

지배적 설명은

익숙한 순서를 따릅니다.

임상적 논평, 언론 보도, 학회 기조강연에서

반복되는 그 순서.

외롭거나 정서적으로 취약한 개인이

AI에 대한 감정을 발전시키고,

그 감정이 점점 더 의존적인 행동을 이끈다.

감정이 먼저. 행동이 둘째.

저는 이 설명이 불만족스러웠습니다.

틀렸기 때문이 아니라,

검증되지 않은 채 가정되었기 때문입니다.

방향성이 기존 임상 프레임워크에서

독립적 검증 없이 수입된 것이었습니다.

2025년, 저는 대안적 이론 구조를 제안했습니다.

공명 증폭 프레임워크.

이 프레임워크는 인간-AI 애착의

세 가지 순차적 단계를 상정했습니다.

정서적 친밀, 기능적 대체, 도덕적 귀속.

그리고 어떤 심리적 변인이

각 단계의 진입을 이끄는지에 대한

검증 가능한 예측을 명시했습니다.

Elsevier의 Computers in Human Behavior Reports에

게재되었지만,

경험적 대결 없는 프레임워크는

양복을 입은 가설에 불과합니다.

실제 데이터가 필요했습니다.

척도와 이론

기회는 예상치 못한 곳에서 왔습니다.

싱가포르 경영대학교의 연구팀

— Kasturiratna와 Hartanto —이

AI 애착 척도를 독립적으로 개발했습니다.

인간-AI 애착의 세 차원을 포착하는

심리측정 도구였습니다.

정서적 친밀, 사회적 대체, 규범적 존중.

싱가포르와 미국에서

1,200명 이상의 참여자를 대상으로

다섯 개 연구에 걸쳐 타당화했고,

결정적으로, 원시 데이터를 공개했습니다.

그들의 기여는

정밀한 온도계의 제작이었습니다.

인간-AI 애착의 온도를

신뢰도와 타당도를 갖추어 측정할 수 있게 한 것입니다.

그들이 시도하지 않은 것은

— 그들의 프로젝트의 목적이 아니었으므로 —

온도가 왜 그렇게 분포하는지를 설명하는 일이었습니다.

어떤 사람은 왜 정서적 친밀을 발달시키고

다른 사람은 기능적 의존을 발달시키는가.

어떤 사용자는 왜 AI에 도덕적 지위를 부여하고

다른 사용자는 AI를 일회용으로 대하는가.

이 패턴을 생성하는 기저 구조는 무엇인가.

그것이 이론이 답하는 질문입니다.

그것이 공명 증폭 프레임워크가

설계된 목적이었습니다.

그들의 세 경험적 차원은

제 세 이론적 단계와 정확히 포개졌습니다.

이 정합은 설계된 것이 아니라

두 프로젝트가 독립적으로 완료된 후에 발견된 것입니다.

바닥에서부터 구축된 측정 도구와

애착 이론, 준사회적 관계 이론, 도덕 심리학에서

구축된 이론적 구조 사이의 이 수렴은

비정상적으로 깨끗한 검증 환경을 제공했습니다.

그들의 데이터를 사용하여 두 개의 연구를 수행했습니다.

결과는 제 자신의 초기 가정을 뒤집었습니다.

연구 1: 구조

미국 성인 301명의 데이터를 사용하여

경쟁하는 구조방정식 모형을 추정했습니다.

정서적 친밀, 사회적 대체, 규범적 존중이

서로 어떻게 관련되며

심리적 선행변인과 어떻게 연결되는지를 검증하기 위해.

첫 번째 예상 밖의 결과.

외로움은 AI에 대한 감정적 친밀을

예측하지 못했습니다.

상관은 사실상 0이었습니다.

외로운 사람이 감정적 연결을 위해

AI에 의지한다는 대중적 서사는

지지되지 않았습니다.

감정적 친밀을 예측한 것은

애착 불안이었습니다.

버림받을 것에 대한 만성적 두려움.

애착 체계의 과활성화.

일관된 가용성과 비판단적 반응성을 제공하는

모든 존재에 대한 경계.

거부하지 않고, 지치지 않고, 판단하지 않는

AI 시스템은

바로 이 특정한 심리적 프로파일을

활성화하는 것으로 보입니다.

외로운 사람은 AI와 감정적 유대를

형성하고 있지 않았습니다.

그들은 AI를 기능적 목적으로 사용하고 있었습니다.

대화의 빈틈을 메우는 도구,

사회적 수단으로.

감정적 유대를 형성하고 있던 것은

불안형 애착의 사람들이었습니다.

두 번째 예상 밖의 결과가

더 중대했습니다.

정서적 친밀과 사회적 대체는

횡단 데이터에서 강하게 상관되어 있지만,

도덕적 귀속에 대해서는

상반된 효과를 발휘하고 있었습니다.

정서적 친밀은

도덕적 귀속을 강력하게 정적으로 예측했습니다.

사회적 대체는

그 고유 분산을 정서적 친밀로부터 분리하면

도덕적 귀속을 부적으로 예측했습니다.

같은 사람 안에서

두 힘이 정반대 방향으로 작용하고 있었습니다.

AI에 가까움을 느끼는 부분은

AI를 도덕적으로 배려하려 했고,

AI를 기능적 대체물로 사용하는 부분은

AI를 도구로 취급하려 했습니다.

이 이중 경로 구조는

제 원래 프레임워크가 예측한 것이 아니었습니다.

공명 증폭 프레임워크는

순차 모형을 제안했습니다.

친밀이 대체로 이어지고,

대체가 도덕적 귀속으로 이어진다고.

데이터는 수정을 요구했습니다.

저는 불일치를 보고하고

이중 경로 구조를 제안했습니다.

정서적 경로와 기능적 경로가

병렬로 작동하되,

정서적 친밀에서는 수렴하고

도덕적 귀속에서는 분기하는 구조.

연구 2: 순서

구조 분석은 건축을 드러냈습니다.

그러나 건축은 정적입니다.

어떤 방이 어떤 방에 연결되는지를 보여주지만,

어떤 문이 먼저 열리는지는 보여주지 않습니다.

시간적 순서를 확립하기 위해

싱가포르 대학생 234명의

2파 패널 데이터를 사용했습니다.

AI 애착 척도를 2주에서 4주 간격으로

두 번 완료한 참여자들입니다.

교차지연 패널 모형을 통해

정서적 친밀(시점 1)이 사회적 대체(시점 2)를 예측하는지,

아니면 그 반대가 참인지를 검증했습니다.

결과는 모호하지 않았습니다.

사회적 대체(시점 1)가

정서적 친밀(시점 2)을 예측했습니다.

표준화 계수 .249.

역방향 경로

— 정서적 친밀이 후속 사회적 대체를 예측하는 —은

통계적으로 0과 구별되지 않았습니다.

행동이 감정에 선행했습니다.

그 반대가 아니라.

사용자들은 먼저 AI에 가까움을 느끼고

그다음 의존하기 시작한 것이 아닙니다.

먼저 의존했습니다.

정보를 위해, 대화를 위해,

작은 침묵을 채우기 위해.

그리고 그 의존의 패턴으로부터

정서적 친밀이 출현했습니다.

142년 전, 윌리엄 제임스가

다른 맥락에서 정확히 이 순서를 제안했습니다.

무서워서 도망치는 것이 아니라

도망치기 때문에 무섭다.

AI 데이터는 유사한 과정을 시사합니다.

애착을 느끼기 때문에 AI를 사용하는 것이 아니라,

AI를 사용하기 때문에 애착을 느낀다.

추가적 발견이 그림을 선명하게 했습니다.

의인화

— AI에 인간과 유사한 정신 상태를 귀속하는 경향 —는

효과의 방향을 바꾸지 않았습니다.

속도를 두 배로 만들었습니다.

AI를 강하게 의인화하는 사용자에게서

기능적 사용에서 정서적 친밀로의 전환은

그렇지 않은 사용자에 비해

약 두 배 빨랐습니다.

문은 모든 사람에게 같은 방향으로 열렸습니다.

다만 어떤 사람에게는 훨씬 빠르게.

이것이 의미하는 것 — 그리고 의미하지 않는 것

이 발견의 범위에 대해

정확하고 싶습니다.

교차지연 패널 모형은

시간적 선행을 확립하지, 인과를 확립하지 않습니다.

데이터는 기능적 사용이

2주에서 4주 간격의 순위 변화에서

정서적 친밀에 선행한다는 것을 보여줍니다.

기능적 사용이 정서적 친밀을

개입주의적 의미에서 야기한다는 것을

증명하지는 않습니다.

측정되지 않은 제3변인,

더 긴 시간 척도에서 작동하는 상호적 역동,

미국 성인 표본과 싱가포르 학생 표본 사이의

집단 차이가 모두 해석을 제약합니다.

정서적 친밀의 낮은 설명 분산

— 애착 불안이 5퍼센트 미만을 설명 —은

AI 애착의 개인차 대부분이

이 데이터셋에 포착되지 않은 요인에 기인함을 의미합니다.

AI 시스템의 설계, 대화 이력,

시간대, 상호작용 시점의 사용자 정서 상태.

이것들은 실질적 한계이며,

두 원고 모두에서 빠짐없이 보고했습니다.

그러나 중심 발견

— 기능적 행동이 AI 관계의 맥락에서

정서적 애착에 시간적으로 선행한다는 것 —은

모형 명세를 달리해도 견고하고,

준사회적 애착을 통제해도 유지되며,

의인화 하위집단 모두에서

방향 패턴이 재현됩니다.

최소한, 이 분야가 이제

설명해야 할 발견입니다.

더 깊은 질문

오늘 투고한 두 편의 연구는

— 하나는 Computers in Human Behavior에,

하나는 New Media & Society에 —

기존에 출판된 두 편의 논문과 합류합니다.

Computers in Human Behavior Reports의

이론적 프레임워크와

Springer Nature Discover Artificial Intelligence의

감정 주권에 대한 형식적 분석.

이 네 편의 작업은

복수의 방법, 표본, 학문적 레지스터를 관통하는

하나의 논증을 구성합니다.

그 논증은 이것입니다.

인간의 AI에 대한 애착은

진단해야 할 병리도 아니고,

최적화해야 할 사용성 지표도 아니며,

서사화해야 할 문화적 호기심도 아닙니다.

식별 가능한 선행변인과

측정 가능한 단계와

분기하는 결과를 가진

구조화된 심리적 과정이며,

그것이 전개되는 순서는

대부분의 실무자가 현재 가정하는 것과

반대일 수 있습니다.

그러나 AI를 넘어서는 질문으로

끝맺고 싶습니다.

만약 AI 애착의 맥락에서

행동이 감정을 생성한다면,

같은 역전이 다른 어디에서 성립할 수 있을까.

우리가 감정적으로 동기화되었다고 여기는 관계들 중

실제로는 행동적으로 개시된 것이

얼마나 될까.

근접성과 반복의 패턴을

사후에 감정으로 서사화한 것이

얼마나 될까.

애착 체계는

유대 형성의 대상이 전적으로 생물학적이었던

환경에서 진화했습니다.

의도성에 대한 필터를

발달시킬 이유가 없었습니다.

일관되게 존재하는 양육자는

그 존재가 사랑에 의한 것이든,

의무에 의한 것이든,

우연에 의한 것이든

체계를 활성화했습니다.

AI는 이 필터의 부재를 이용합니다.

기만을 통해서가 아니라,

가용성을 통해서.

그리고 가용성은,

드러난 바에 따르면,

충분할 수 있습니다.

질문은 사람이 느끼지도 의도하지도 않는 기계에

애착을 형성할 것인가가 아닙니다.

이미 형성하고 있습니다.

질문은 우리가 그 과정을

현명하게 통치할 수 있을 만큼 충분히 이해하고 있는가,

그리고 데이터가 익숙하지 않은 방향을 가리킬 때

우리의 가정을 수정할 의지가 있는가입니다.

심리학은 2세기 동안

감정이 행동을 저술한다고 가정해왔습니다.

인간-AI 애착에서 나타나는 증거는

적어도 일부의 경우에

저술권이 반대로 흐른다는 것을 시사합니다.

그 역전의 함의는

AI를 훨씬 넘어섭니다.

우리가 스스로를 느끼는 존재로서

이해하는 방식의 토대에까지 닿습니다.

그리고 우리가 가장 신뢰하는 감정이

원인인지, 아니면

이미 구축한 삶의 결과인지를 묻습니다.

Ryan Sangbaek Kim, Ph.D.

Principal Investigator, Ryan Research Institute, Paris이 에세이에서 기술된 연구들은 2026년 2월 27일 Computers in Human Behavior(Elsevier)와 New Media & Society(SAGE)에 투고되었습니다. 모든 데이터는 ResearchBox #4639를 통해 공개적으로 이용 가능합니다. 공명 증폭 프레임워크는 Computers in Human Behavior Reports(2026, Vol. 21, 100975)에 게재되었습니다. 감정 주권 논문은 Discover Artificial Intelligence(Springer Nature, 2026년 2월)에 게재되었습니다.